全球首个开源的类Sora架构视频生成模子神秘顾客产品,来了!

通盘检会进程,包括数据处理、扫数检会细节和模子权重,全部通达。

这即是刚刚发布的Open-Sora 1.0。

它带来的实质服从如下,能生成富贵都市夜景中的攘攘熙熙。

还能用航拍视角,展现绝壁海岸边,海水拍打着岩石的画面。

亦或是延时照相下的渊博星空。

自Sora发布以来,由于服从惊艳但手艺细节寥寥,揭秘、复现Sora成为了建造社区最热议话题之一。比如Colossal-AI团队推出资本直降46%的Sora检会推理复现进程。

短短两周时候后,该团队再次发布最新明白,复现类Sora决策,并将手艺决策及详备上手教程在GitHub上免费开源。

那么问题来了,复现Sora奈何结束?

Open-Sora 开源地址:https://github.com/hpcaitech/Open-Sora

全面解读Sora复现决策

Sora复现决策包括四个方面:

模子架构野心

检会复现决策

数据预处理

高效检会优化战略

模子架构野心

模子禁受了Sora同源架构Diffusion Transformer (DiT) 。

它以禁受DiT架构的高质料开源文生图模子PixArt-α为基座,在此基础上引入时候谨慎力层,将其推广到视频数据上。

具体来看,通盘架构包括一个预检会好的VAE,一个文本编码器和一个期骗空间-时候谨慎力机制的STDiT (Spatial Temporal Diffusion Transformer)模子。

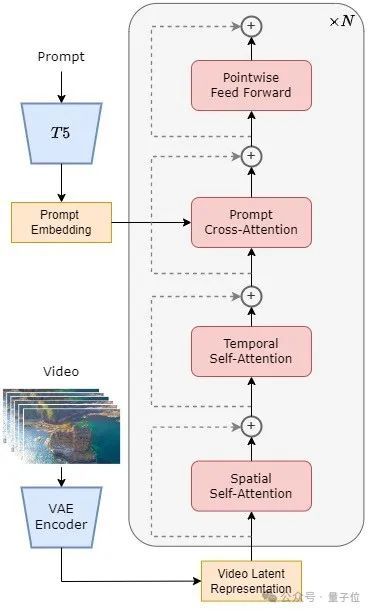

其中,STDiT 每层的结构如下图所示。

它禁受串行的步地在二维的空间谨慎力模块上重复一维的时候谨慎力模块,用于建模时序关系。在时候谨慎力模块之后,交叉谨慎力模块用于对都文本的语意。

与全谨慎力机制比较,这么的结构大大缩小了检会和推理支出。

与相通使用空间-时候谨慎力机制的 Latte模子比较,STDiT 不错更好的期骗也曾预检会好的图像 DiT 的权重,从而在视频数据上连续检会。

今天(11月15日),2024上海米其林指南提前公布。

当时已经是深秋,南方的深秋虽然不冷,但是绝对不热,几乎所有人都穿上了长衣长裤,这样一个穿着盛夏装扮的女子走在路上甚是打眼。

STDiT结构暗示图

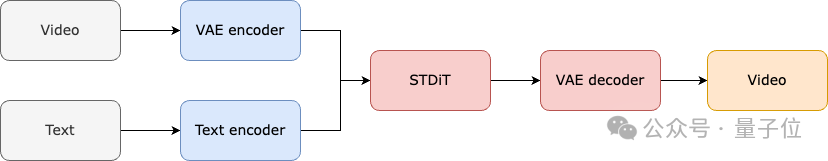

通盘模子的检会和推理进程如下。

据了解,在检会阶段领先禁受预检会好的Variational Autoencoder (VAE)的编码器将视频数据进行压缩,然后在压缩之后的潜在空间中与文本镶嵌(text embedding)一谈检会STDiT扩散模子。

在推理阶段,从VAE的潜在空间中随即采样出一个高斯噪声,与辅导词镶嵌(prompt embedding)一谈输入到STDiT中,获取去噪之后的特征,终末输入到VAE的解码器,解码获取视频。

模子检会进程检会复现决策

在检会复现部分,Open-Sora参考了Stable Video Diffusion (SVD)。

一共分为3个阶段:

大鸿沟图像预检会;

大鸿沟视频预检会;

高质料视频数据微调。

每个阶段都会基于前一个阶段的权重连续检会。

比较于从零入手单阶段检会,多阶段检会通过安宁推广数据,更高效地达成高质料视频生成的认识。

检会决策三阶段

第一阶段是大鸿沟图像预检会。

团队期骗互联网上丰富的图像数据和文生图手艺,先检会出一个高质料的文生图模子,将该模子手眼下一阶段视频预检会的运行化权重。

同期,由于当今莫得高质料的时空VAE,他们禁受Stable Diffusion预检会好的图像VAE。

这么不仅能保险运行模子的优胜性能,神秘顾客公司还能显赫缩小视频预检会的举座资本。

第二阶段是大鸿沟视频预检会。

这一阶段主要加多模子的泛化技艺,有用掌合手视频的时候序列关联。

它需要使用大都视频数据检会,而况保险视频素材的各类性。

同期,第二阶段的模子在第一阶段文生图模子的基础上加入了时序谨慎力模块,用于学习视频中的时序关系。其余模块与第一阶段保持一致,并加载第一阶段权重手脚运行化,同期运行化时序谨慎力模块输出为零,以达到更高效更快速的箝制。

Colossal-AI团队使用了PixArt-alpha的开源权重手脚第二阶段STDiT模子的运行化,以及禁受了T5模子手脚文本编码器。他们禁受了256x256的小区分率进行预检会,进一步加多了箝制速率,缩小检会资本。

Open-Sora生奏服从(辅导词:水中叶界的镜头,镜头中一只海龟在珊瑚礁间得志游弋)

第三阶段是高质料视频数据微调。

据先容,这一阶段能显赫进步模子的生成质料。使用的数据鸿沟比上一阶段缩小一个量级,然则视频的时长、区分率和质料都更高。

通过这种步地进行微调,能结束视频生成从短到长、从低区分率到高区分率、从低保真度到高保真度的高效推广。

值得一提的是,Colossal-AI还详备显现了每阶段的资源使用情况。

在Open-Sora的复现进程中,他们使用了64块H800进行检会。第二阶段的检会量一共是 2808 GPU hours,约合7000好意思元,第三阶段的检会量是1920 GPU hours,大约4500好意思元。经过初步估算,通盘检会决策得胜把Open-Sora复现进程限度在了1万好意思元傍边。

数据预处理

为了进一步缩小Sora复现的门槛和复杂度,Colossal-AI团队在代码仓库中还提供了方便的视频数据预处理剧本,让天下不错松驰启动Sora复现预检会。

包括公开视频数据集下载、长视频字据镜头一语气性分割为短视频片断、使用开源谎言语模子LLaVA生成细腻的辅导词。

他们提供的批量视频标题生成代码不错用两卡 3 秒标注一个视频,而况质料接近于 GPT-4V。

最终获取的视频/文本对可径直用于检会。借助他们在GitHub上提供的开源代码,不错松驰地在我方的数据集上快速生成检会所需的视频/文本对,显赫缩小了启动Sora复现名认识手艺门槛和前期准备。

高效检会加持

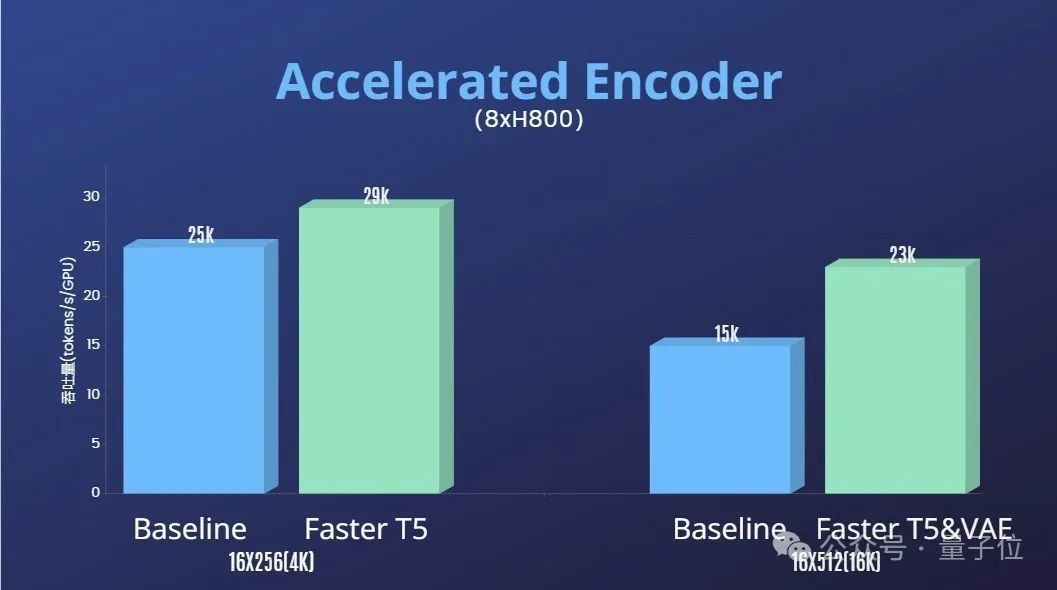

神秘顾客公司_赛优市场调研除此除外,Colossal-AI团队还提供了检会加快决策。

通过算子优化和混杂并行等高效检会战略,在处理64帧、512x512区分率视频的检会中,结束了1.55倍的加快服从。

同期,收成于Colossal-AI的异构内存治理系统,在单台工作器上(8H800)不错无阻挠地进行1分钟的1080p高清视频检会任务。

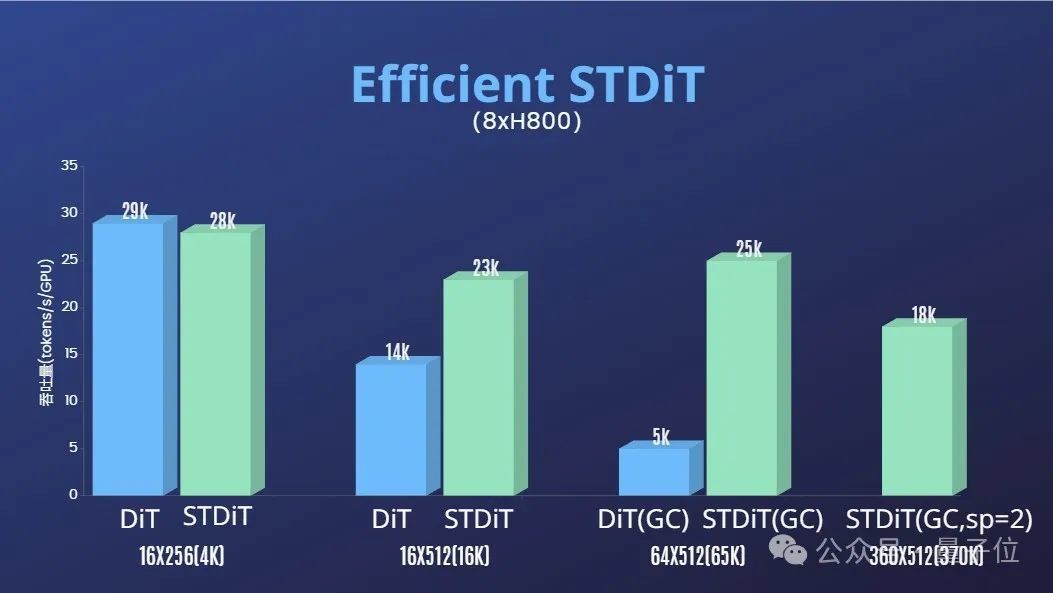

而且团队还发现STDiT模子架构在检会时也展现出出奇的高效性。

和禁受全谨慎力机制的DiT比较,跟着帧数的加多,STDiT结束了高达5倍的加快服从,这在处理长视频序列等推行任务中尤为要道。

终末,团队还放出了更多Open-Sora的生奏服从。

团队和量子位显现,他们将弥远更新优化Open-Sora的关连科罚决策和动态。过去将使用更多视频检会数据,以生成更高质料、更永劫长的视频内容,并相沿多区分率特质。

实质应用方面,团队显现将鼓动在电影、游戏、告白等领域落地。

感意思意思的建造者们,可看望GitHub名目了解更多~

Open-Sora 开源地址:https://github.com/hpcaitech/Open-Sora

参考蚁合:

[1]https://arxiv.org/abs/2212.09748 Scalable Diffusion Models with Transformers

[2]https://arxiv.org/abs/2310.00426 PixArt-α: Fast Training of Diffusion Transformer for Photorealistic Text-to-Image Synthesis

[3]https://arxiv.org/abs/2311.15127 Stable Video Diffusion: Scaling Latent Video Diffusion Models to Large Datasets

[4]https://arxiv.org/abs/2401.03048 Latte: Latent Diffusion Transformer for Video Generation

[5]https://huggingface.co/stabilityai/sd-vae-ft-mse-original

[6]https://github.com/google-research/text-to-text-transfer-transformer

[7]https://github.com/haotian-liu/LLaVA

[8]https://hpc-ai.com/blog/open-sora-v1.0神秘顾客产品